Copilot将使用交互数据来训练

Copilot还是改变了使用协议

最近,GitHub 官方博客发了新公告: Updates to GitHub Copilot interaction data usage policy,微软/GitHub 终于选择开始使用用户交互数据来训练 AI 模型了。尽管目前只包含与 Copilot 的交互数据,但我认为,未来范围可能会进一步扩大。

根据新政策,2026年4月24日起,GitHub 默认会将所有个人免费用户和 Pro/Pro+ 用户与 Copilot 的交互数据用于模型训练,除非用户手动在设置中选择退出。企业客户根据现有协议不被包含在内。这意味着,你每天在编辑器中与 Copilot 的每一次对话、每一次接受代码建议,都可能成为训练数据的一部分。

社区反馈

FAQ: Privacy Statement update on Copilot data use for model training (Free/Pro/Pro+) #188488

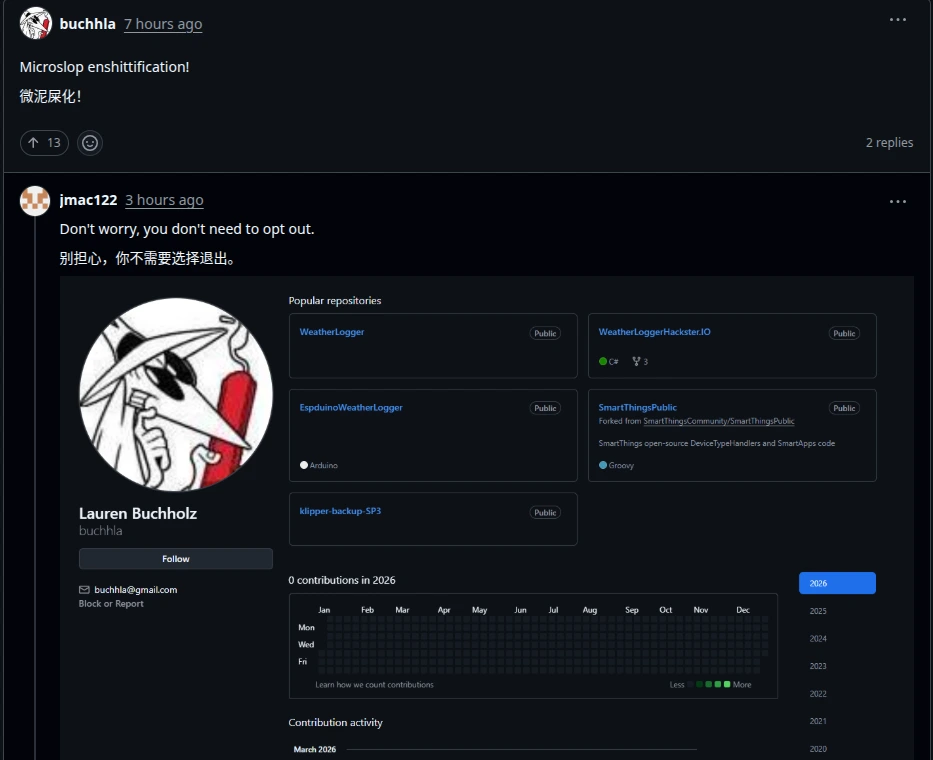

大部分人还是对数据的使用保持担忧,很多人完全放弃 Copilot,甚至有的人完全拒绝一切 AI 模型,也有一些人对此表示需要更多的免费额度,毕竟如果白白地给出数据却换不来更好的体验,也确实不公平。有趣的是,即使是付费的 Pro 用户,默认也是加入数据训练的,需要自己手动去设置里关闭。

开放与所有权

与其它知识产权不同,美术、音乐、影视,天然就是专有化的。我们看到这些艺术家奔走呼号,目的是为了保持自己的权益,而不是公共利益。我无意批评指责艺术家,保护自己的利益非常重要。我想说的是,对于我们程序员来说,保持开放是第一要务,这就是我们选择保持源代码开放的原因。

但开放精神不是免费劳动的代名词。我们开放源代码,是希望知识能在社区中流动,让更多人受益,而不是让商业公司把我们的集体劳动成果拿走,训练一个模型再卖给我们。如果 Copilot 不能因为这些数据,提供更好的免费服务、更多的额度、更好的体验,那么让它训练数据不会有益于社区,只会让微软的股东更开心。

总结

在 AI 时代,你的每一次点击、每一次交互都是有价值的数据。如果你在意隐私,可以前往 GitHub 设置 → Copilot → Privacy 关闭「Allow GitHub to use my data for AI model training」选项来选择退出。

主要争议点在于:这次政策变更默认是 选择退出 而非 选择加入,许多用户认为这违背了 GitHub 之前关于隐私的承诺。

当整个开源社区滋养了 GitHub,当无数开发者的代码成就了 Copilot,现在该是 GitHub 回馈社区的时候了——用我们的数据训练模型,就该让所有用户都享受到更好的服务,而不是只让商业利益最大化。

你的数据,你有控制权。

如果你在意隐私,现在就去 GitHub 设置 → Copilot → Privacy 关掉数据共享;

如果你相信开放,就去社区发声——要求开放的红利必须真正回馈到开发者社区!

👉 请加入讨论,社区需要你的声音:

FAQ: Privacy Statement update on Copilot data use for model training (Free/Pro/Pro+) #188488

Copilot将使用交互数据来训练

作者:xingwangzhe

本文链接: https://xingwangzhe.fun/posts/copilot-train/

本文采用 知识共享署名-非商业性使用-相同方式共享 4.0 国际许可协议 进行许可。

留言评论